告别AI切换内耗!ChatALL:一款让多模型并行工作的效率神器

在AI大模型百花齐放的今天,我们或许都有过这样的困扰:写代码时,ChatGPT速度快但偶尔出错,Claude更严谨却响应偏慢;做学术研究时,需要对比不同模型的输出差异,却要在多个平台间反复切换、复制粘贴相同问题;整理文案时,想收集多风格素材,却要逐个给不同AI发指令,耗时又费力。

有没有一款工具,能打破这种低效壁垒,让多个AI模型同时为我们服务?答案是肯定的——ChatALL(中文名:齐叨),这款开源AI聚合工具,以“一次提问,多模型并行响应”为核心,彻底重塑了我们使用AI工具的方式,成为开发者、研究者、内容创作者的高效协作伙伴。

不同于单一AI工具的局限,也区别于普通多模型集成工具的繁琐,ChatALL的核心价值的是“聚合”与“高效”,它不生产AI模型,却能让所有主流AI模型发挥最大价值,帮我们省去切换成本、提升决策效率,今天就来严谨、全面地聊聊这款工具。

一、什么是ChatALL?核心定位与优势

ChatALL是一款跨平台的AI对话聚合工具,本质是一个“AI模型协作工作台”,其核心功能是将你的提问同时发送给多个主流AI模型,实现多模型并行响应,让你在单一界面中直观对比所有回答,快速筛选出最佳方案,无需在多个AI平台间来回切换。

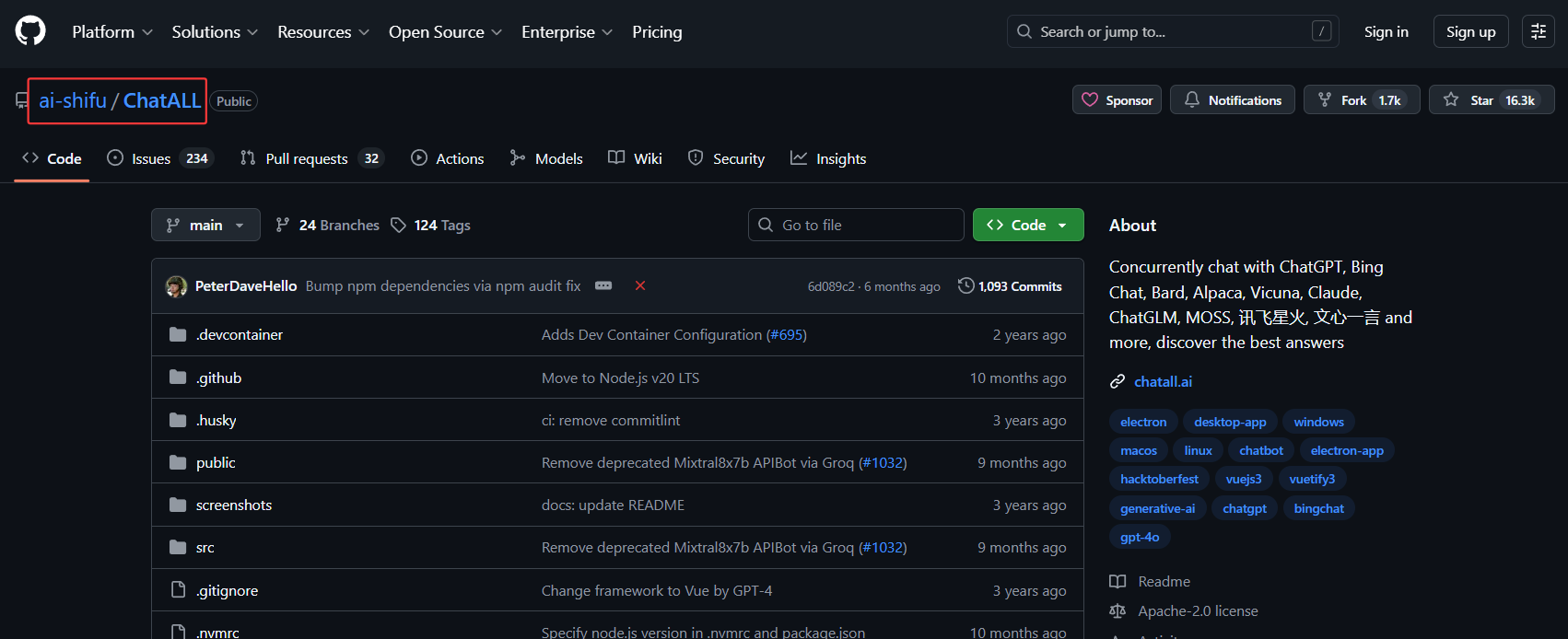

作为一款开源工具(GitHub星标累计30k+),ChatALL支持Windows、macOS、Linux三大主流操作系统,兼容多语言(中文、英语、德语、法语等),且坚持“本地优先”的隐私理念,所有对话历史、设置及API密钥均存储在用户本地设备,最大程度保护用户隐私安全。

https://github.com/ai-shifu/ChatALL

与同类多模型工具相比,ChatALL的核心优势尤为突出:

1. 无冗余操作,效率翻倍:无需重复输入问题、切换平台,一次提问即可获得多个AI的并行响应,实测显示,原本需要47分钟的多平台对比工作,使用ChatALL仅需12分钟,重复操作减少90%以上;

2. 模型覆盖全面,适配多场景:截至2026年初,已支持50+主流AI模型,涵盖国际模型(ChatGPT、Claude、Gemini等)、国产模型(文心一言、讯飞星火、通义千问等)、开源模型(ChatGLM、CodeLlama、Llama系列等),可根据需求自由选择启用或禁用任意模型;

3. 操作门槛低,上手简单:无需复杂部署,下载安装后,配置对应AI的API密钥或登录账号即可使用,支持一键切换单栏、双栏、三栏视图,方便对比查看不同模型的回答;

4. 功能实用,适配专业需求:除核心的并行对话的功能外,还支持快速提示模式(无需等待上一个请求完成即可发送下一个提问)、对话历史本地保存、优质回答高亮、提示词管理、代理设置等实用功能,满足不同用户的专业需求。

二、核心功能详解:每一个设计都贴合高效需求

ChatALL的功能设计围绕“高效协作”展开,没有冗余的花哨功能,每一项都直击用户痛点,我们从实用角度,拆解其核心功能:

1. 多模型并发对话:一次提问,多AI响应

这是ChatALL最核心的功能。用户只需在输入框中输入问题,选择需要调用的AI模型(可批量选择),点击发送,工具就会同时向所有选中的模型发送提示,各模型并行响应,回答会实时展示在同一界面,无需等待某个模型完成响应再发送下一个请求。

值得注意的是,对于支持网页访问的模型(如360 AI Brain、ChatGLM等),由于依赖反向工程适配平台接口,可能会因平台界面更新、安全策略调整出现稳定性问题;而支持API访问的模型(如ChatGPT、Claude、文心一言等),响应更稳定、可靠,官方也更推荐优先使用API驱动型模型。

2. 智能对比与筛选:快速找到最佳答案

多模型响应后,ChatALL会以清晰的布局展示所有回答,支持高亮标记优质回答、删除无效回答,还能直观对比各模型的响应速度、回答质量、信息密度等维度,帮助用户快速判断哪个模型的回答更贴合需求。

对于需要深度对比的场景(如研究者对比不同模型的性能差异、开发者调试提示词),ChatALL还支持导出对比报告(支持Markdown/Word/JSON格式),方便后续整理、分析和分享。

3. 隐私保护与数据安全:本地存储,放心使用

隐私安全是很多用户使用AI工具的核心顾虑,而ChatALL在这一点上做得十分严谨:所有聊天历史、用户设置、API密钥等核心数据,均存储在用户本地计算机,不上传至任何云端服务器;工具仅收集匿名使用数据(如调用的模型类型、提示词长度、响应时长等),用于优化产品,且不包含任何提示内容和响应内容,用户也可手动关闭匿名数据收集功能。

4. 高级实用功能:适配专业场景需求

除了核心功能,ChatALL还内置了多项提升效率的高级功能,覆盖不同用户的专业需求:

– 提示词管理:可保存常用提示词模板,后续使用直接调用,无需重复输入,尤其适合开发者、内容创作者等需要高频使用固定提示词的人群;

– 多会话管理:支持同时开启多个会话,不同会话可配置不同的模型组合,方便区分不同任务(如一个会话用于代码开发,一个用于文案创作);

– 快捷键支持:按下Ctrl+/可查看所有快捷键,如快速发送、切换视图、删除回答等,进一步提升操作效率;

– 自动更新:支持自动更新至最新版本,无需手动下载安装,确保用户能及时使用新增功能和模型适配补丁;

– 自定义模型组合:可创建“模型组合模板”,将常用的模型搭配保存(如“代码开发组合”包含ChatGPT、Claude、CodeLlama),一键激活,适配特定任务场景。

三、适用人群:谁最适合用ChatALL?

ChatALL的定位并非“替代单一AI模型”,而是“提升多模型使用效率”,因此更适合有多模型使用需求的人群,根据官方数据及实际使用场景,以下几类人群使用体验最佳:

1. 开发者/工程师:可同时验证不同AI模型的代码生成、调试、优化效果,快速定位最佳实现方案,尤其适合需要对比不同模型代码质量、效率的场景;

2. 研究者/学者:可直观对比不同AI模型在特定领域(如学术写作、数据解读)的性能差异,收集对比数据,生成可视化对比报告,降低研究成本;

3. 内容创作者(文案、编辑、设计师等):可同时获取多个AI模型的创意素材、文案方案,对比不同风格的输出,快速筛选出贴合需求的内容,提升创作效率;

4. AI爱好者/学习者:可轻松探索不同AI模型的优势与短板,无需逐个注册、切换平台,快速了解各类模型的特点,降低AI学习门槛;

5. 企业决策者/分析师:可通过多模型并行响应,获取更全面的信息参考(如市场分析、方案评估),减少单一模型的局限性,提升决策准确性。

四、使用注意事项:这些细节要留意

为了让大家更严谨、安全地使用ChatALL,结合工具特性和官方提示,整理了以下几点注意事项:

1. 工具定位:ChatALL是客户端工具,并非代理工具,使用前需确保自己拥有对应AI模型的账号和/或API密钥,且具备可靠的网络连接(部分国际模型需配置合理网络环境),否则无法正常调用模型;

2. 模型稳定性:网页访问型模型(无API支持)受平台更新影响较大,可能出现无法调用、响应失败等问题,优先选择API驱动型模型可提升使用稳定性;

3. API密钥安全:API密钥属于敏感信息,需妥善保管,避免泄露,ChatALL虽会加密存储密钥,但仍建议用户定期更换密钥,降低安全风险;

4. 功能局限性:ChatALL目前不支持本地模型的离线运行(需依赖网络调用模型),且部分小众AI模型暂未适配,后续会通过插件化架构持续新增支持;

5. 开源特性:ChatALL是开源项目,欢迎用户参与功能贡献,官方也在规划多项新功能(如AI能力自动识别、本地模型集成、API工作流自动化等),后续会持续优化体验。

五、总结:让AI协作更高效,让选择更简单

在AI模型日益增多的今天,我们的核心需求早已不是“拥有更多AI账号”,而是“让AI更好地为我们服务”。ChatALL的出现,恰好解决了多模型使用中的“切换内耗”“对比繁琐”“效率低下”等痛点,它以简洁的界面、实用的功能、严谨的隐私保护,让多模型协作变得简单高效。

对于需要频繁使用多个AI模型的用户来说,ChatALL不是“可选工具”,而是“必备工具”——它不用你花费过多时间学习操作,不用你在多个平台间来回奔波,只需一次提问,就能汇聚多个AI的智慧,帮你快速找到最佳方案,节省的不仅是时间,更是精力。

如果你也经常被多AI切换困扰,如果你想让AI协作更高效,不妨试试ChatALL,相信它会成为你探索AI世界、提升工作效率的得力助手。

最后提醒:ChatALL可在GitHub、GitCode等官方渠道免费下载,建议通过官方渠道获取安装包,避免下载非官方版本带来的安全风险。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

重要提醒!重要提醒!重要提醒:请勿轻易相信各类网站的内容及广告! |

暂无评论...